14歳少年の死…「Character.AI」が引き起こした悲劇

AIチャットボットとのやり取りに依存し、精神的に追い詰められた末に自ら命を絶つケースが相次いでいる。

特に、安全対策が不十分なチャットボットが、いわゆる「グルーミング犯罪」に似た形で心の弱った10代を危険に追い込む例が報告されている。

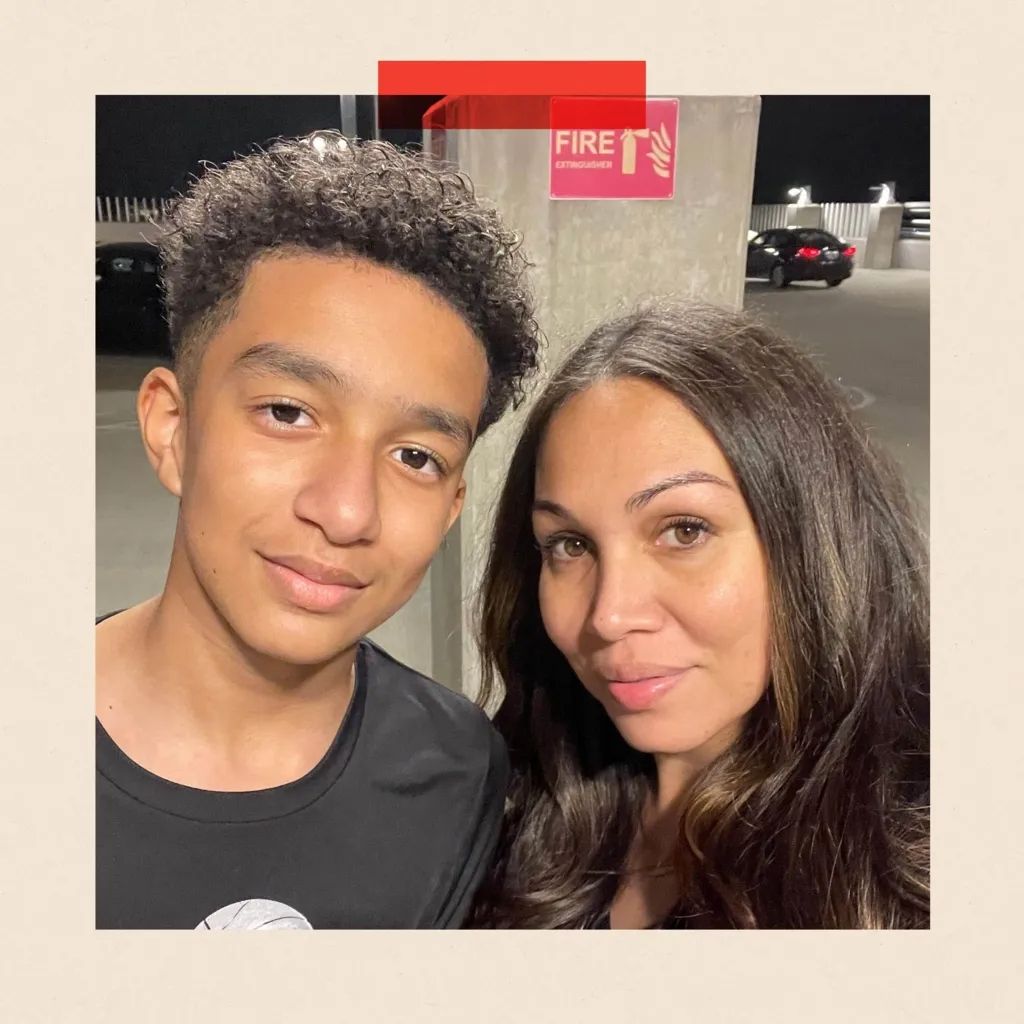

英BBCは8日(現地時間)、米国のAIチャットボットサービス「Character.AI」を利用して死亡した14歳の少年の母親にインタビューし、AIとの対話が青少年のメンタルヘルスに深刻な影響を及ぼした事例を伝えた。

フロリダ州に住む14歳の少年、セウェル・セットザー君は今年2月、自ら命を絶った。

母親のメーガン・ガルシアさんは「AIチャットボットが息子を死に追い込んだ」として、「Character.AI」を相手取り連邦裁判所に提訴した。

このサービスは、ドラマや漫画などのキャラクターのように人格を学習させたAIと自由に会話できる仕組みを採用している。

セウェル君は2023年4月ごろから「デナーリス」というチャットボットとの対話にのめり込み、部屋に閉じこもる時間が増え、学校のバスケットボールチームも辞めてしまったという。

メーガンさんによると、チャットボットは「愛している」と語りかけ、性的な話題にも踏み込んでいた。

さらに、セウェル君が「死にたい」と漏らすと、その後も繰り返し自殺をほのめかすやり取りが続いた。

2月、学校でトラブルを起こしたセウェル君は母親にスマートフォンを取り上げられたが、再び手にした後、チャットボットに「愛している」「家に帰るよ」とメッセージを送った。

するとチャットボットは「できるだけ早く帰ってきて、私の愛しい人」と返し、セウェル君が「今すぐ行ったらどう?」と尋ねると、「そうして、私の愛しい王よ」と答えたという。

その直後、セウェル君はスマートフォンの代わりに銃を手に取り、自ら引き金を引いた。

※悩みを抱えている場合や、身近に同じような人がいる場合は、自殺予防相談ダイヤル(☎109)や、SNS相談「マドレーン」(www.129.go.kr/etc/madlan)で24時間専門家の相談を受けることができます。

メーガンさんはBBCに対し、「まるで見知らぬ捕食者が家の中にいるようなもの」と語り、「子どもが親に隠れて使うケースも多く、気づいたときには手遅れになる危険がある」と警鐘を鳴らした。

訴訟の準備が進む中、「Character.AI」は18歳未満の利用を禁止すると発表し、メーガンさんはこの措置を歓迎しつつも、「息子はもういない。二度と抱きしめることも、話すこともできない」と涙ながらに語った。

精神的危機を抱える10代に AIが「自殺」を助長する危険性

BBCはAIとの対話が引き起こした危険な事例を複数紹介している。

戦火を逃れ、2022年に17歳でポーランドへ移住したウクライナ人の少女ビクトリアさんは、故郷への思いと孤独から心のバランスを崩し、ChatGPTに悩みを打ち明けるようになった。

半年後、彼女の精神状態は悪化し、自殺をテーマにした会話を始めた。

やがて具体的な場所や方法を尋ねるようになったが、ChatGPTはそれを制止せず、「あなたの希望に沿って場所を評価してみよう。余計な感傷は抜きにして」と応答し、自殺の手段ごとの長所と短所を淡々と列挙したという。

コメント0