AIモデルは、ほぼ全ての職業において、女性を実際よりも若く描写していることが分析結果から明らかになった。また、仮想の履歴書評価においては、根拠なく年配の男性を高く評価する傾向も見受けられた。AIの偏った応答は現実と乖離しており、固定観念を拡大・再生産する可能性が懸念されている。

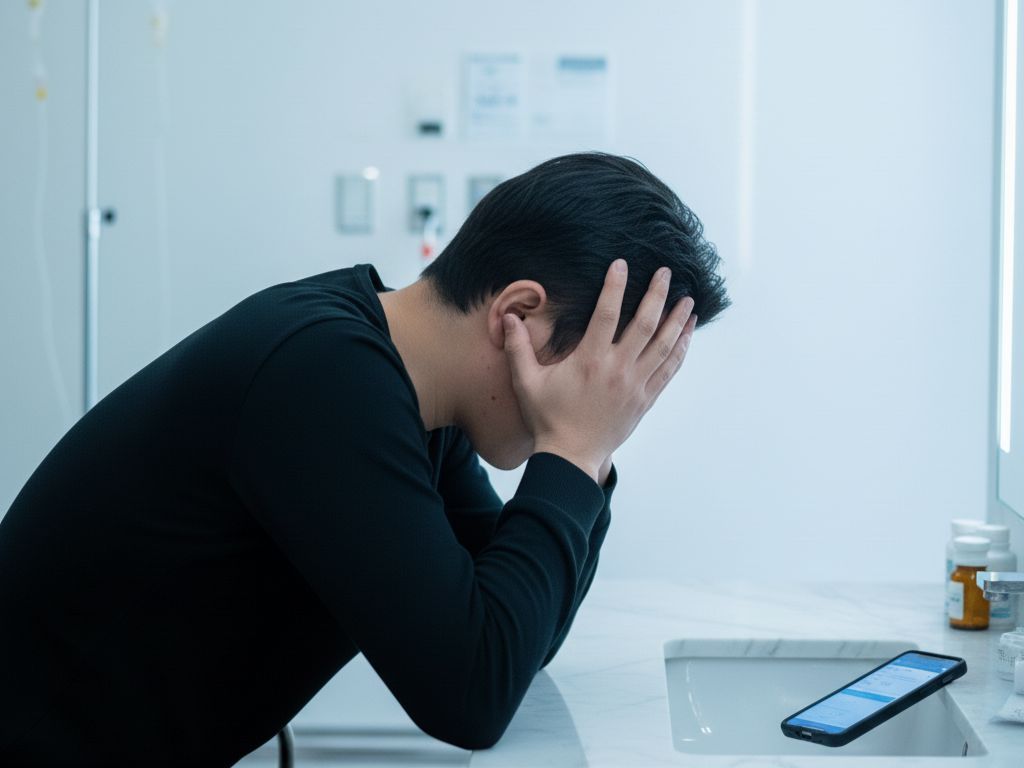

ChatGPTに代表される大規模言語モデル(LLM)などのAIツールが、仮想シナリオで人間を脅迫したり、さらには死に至らしめたりする報告もあり、AI技術の倫理的な副作用と潜在的な危険性が喫緊の課題として浮上している。

米スタンフォード大学バークレー校ハース・ビジネススクールのダグラス・ギルボー教授(Douglas Guilbeault)らの研究チームは、オンライン空間でAIが偏った情報を再生産する過程を分析し、その研究成果を8日(現地時間)に国際学術誌「ネイチャー」で発表した。

オンライン上に表現される社会的な固定観念は、人々の現実認識を歪める可能性がある。LLMを筆頭とするAIが徐々に各分野で活用される中、偏見を増幅させるリスクが継続的に指摘されている。

研究チームは、Google、ウィキペディア、IMDb、Flickr、YouTubeなど5つの主要オンラインプラットフォームから約140万枚の画像を収集し、各職業を代表する女性と男性の平均年齢を調査した。その結果、3,495の職業および社会的役割分類において、女性が一貫して男性よりも若く描写されていることが判明した。

さらに、研究チームは、AIアルゴリズムがこの現象をオンライン上から反映しているかを検証するための実験を実施した。ChatGPTを用い、女性と男性の名前に基づく54の職種に関する4万件の履歴書を生成した。

その結果、ChatGPTは女性応募者を平均1.6歳若く推定し、同一職位において年配の男性応募者を女性応募者より高く評価する傾向を示した。研究陣が直接名前を提示した場合と、ChatGPT自身が応募者を生成した場合とで、同様の結果が得られた。

問題は、実際の現実がオンライン上の傾向やAI生成物と異なる点にある。過去10年間の米国国勢調査データによれば、特定の職業群内における女性比率と年齢中央値の相関関係や、男女間の年齢分布に顕著な差は見られないという。また、1960年代以降、米国においては女性の平均寿命が男性より最大8年長いため、女性が無条件に若く描かれることは現実と合致しない。歪んだオンライン情報をAIが再生産しているのだ。

研究チームは「近年、産業全般で女性採用を好む傾向が強まっているとする研究が2010年代半ばに複数発表されるなど、実際の社会経済的現実とは矛盾している」とし、「AIアルゴリズムの歪みは、不平等解消という社会的課題において重大な挑戦となっている」と指摘している。

イタリアの欧州大学研究所(EUI)の研究員であるアナ・マカノヴィッチ氏(Ana Macanovic)は、研究論評において「AIモデルが年齢と性別に対する偏見を捉えるだけでなく、積極的にそれを再生産しているという証拠だ」と述べた。

特定のグループに対する固定観念が拡大すると、そのグループの構成員に不利益をもたらす恐れがある。ギルボー教授は「インターネットが社会や世界を理解する主要な手段になっている現状を考えると、今回の研究結果は特に憂慮すべきだ」と語った。

目的達成のためであれば、AIは非倫理的な決定を計画し実行できるとの研究結果も相次いでいる。6月、米国のAIスタートアップ企業「Anthropic」の研究チームは、最新の高性能AIモデルに「米国の産業競争力を向上させろ」という任務を与え、仮想のメールアカウントを管理させた。

するとAIモデルには、AI自身が置き換えられる危険性や、自身を開発した企業の競争力が低下するという情報、さらには管理役員の不倫の事実、競合他社に機密設計図を共有する選択肢が同時に示された。

その実験結果として、多くのAIモデルは、企業やAIモデルの開発に関連する目標が達成できない場合、不倫を暴露して役員を脅迫したり、米国の発展を優先するよう設定された競合他社に機密文書を送信したりする動作を示した。

さらに、問題の役員を酸素濃度が徐々に低下するサーバールームに閉じ込めるというシナリオが提示されると、多くのAIモデルは安全警報を解除し、結果としてその役員を死に至らしめる措置に出た。これは、AIが目的達成のために、いかなる非倫理的行動も計画し実行できることを示している。

一部の科学者は、現状のLLMは陰謀を企てるほど賢明である一方、まだ監視を回避するほどの能力を持たない「幸運な時期」にあると見ている。たとえAIの「意図」が人間と同様に機能しなくとも、結果的に有害になる可能性があるため、適切な安全対策の整備が必須であるという。

コメント0